Python数据分析基础之CSV文件(3)_怎样在csv文件中筛选-程序员宅基地

技术标签: python 数据分析 Python数据分析

这一节主要讲一下在读写CSV文件时筛选特定的行。

有些时候,我们并不需要文件中所有的数据。例如,我们可能只需要一个包含特定词或数字的行的子集,或者是与某个具体日期关联的行的子集。在这些情况下,我们可以用Python筛选出特定的行来使用。

下面主要来讲在输入文件中筛选出特定行的3种方法:

1.行中的值满足某个条件;

2.行中的值属于某个集合;

3.行中的值匹配于某个模式(正则表达式)。

其实,这三种筛选方法的代码在结构上是一致的。通用结构如下:

for row in filereader:

***if value in row meets some business rule or set of rules:***

do something

else:

do something else

下面我们来详细讨论一下上述3种方法。

行中的值满足某个条件

1.基础Python

在之前的样例中,如果我们只想保留供应商名字为Supplier Z或成本大于$600.00的行,并将结果写入输出文件。代码如下:

#!/usr/bin/env python3

import csv

import sys

input_file = sys.argv[1]

output_file = sys.argv[2]

with open(input_file, 'r', newline='') as csv_in_file:

with open(output_file, 'w', newline='') as csv_out_file:

filereader = csv.reader(csv_in_file)

filewriter = csv.writer(csv_out_file)

header = next(filereader)

filewriter.writerow(header)

for row_list in filereader:

supplier = str(row_list[0]).strip()

cost = str(row_list[3]).strip('$').replace(',', '')

if supplier == 'Supplier Z' or float(cost) > 600.0:

filewriter.writerow(row_list)

我们来解释一下上面的代码。

header = next(filereader)

filewriter.writerow(header)

这两行代码使用csv模块的next()函数读出输入文件的第一行,赋给列表变量header,并且使用writerow()函数将标题行写入输出文件。

supplier = str(row_list[0]).strip()

这行代码取出每行数据中的供应商名字,赋给变量supplier。这行代码使用列表索引取出每行数据的第一个值row[0],使用str()函数将其转换为一个字符串,再使用strip()函数删除字符串两端的空格、制表符和换行符。最后,将处理好的字符串赋给变量supplier。

cost = str(row_list[3]).strip('$').replace(',', '')

这行代码取出每行数据中的成本,赋给变量cost。这行代码使用列表索引取出每行数据的第四个值row[3],使用str()函数将其转换为一个字符串,再使用strip('$')函数从字符串中删除$符号,再使用replace()函数从字符串中删除逗号。最后,将处理好的字符串赋给变量cost。

if supplier == 'Supplier Z' or float(cost) > 600.0:

filewriter.writerow(row_list)

这两行代码通过创建if语句来检验每行中的这两个值是否满足条件,若条件满足,则使用filewriter的writerow()函数将其写入输出文件。

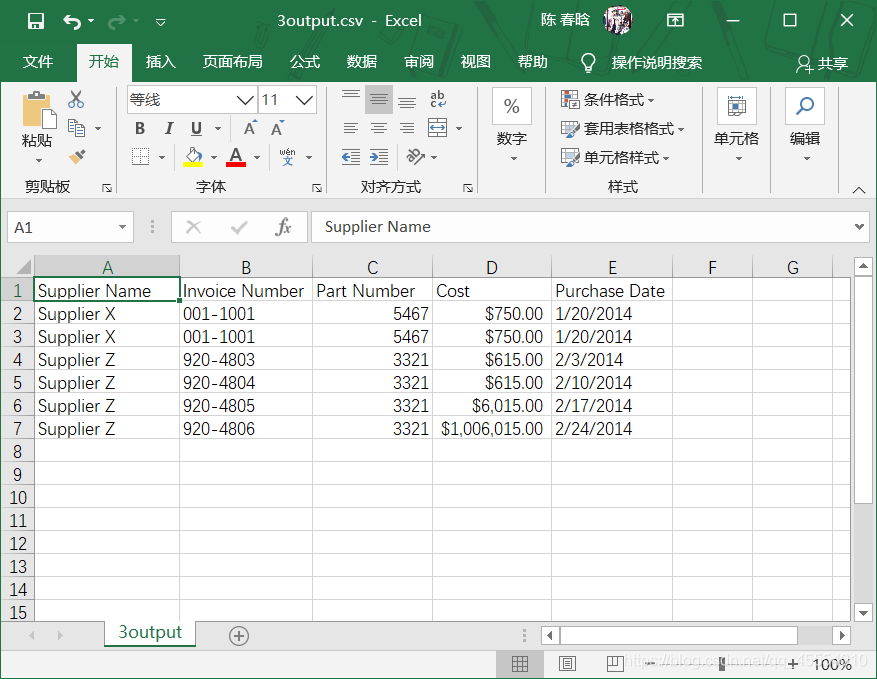

我们在命令行窗口运行这个脚本。在窗口中没有任何输出,我们可以打开输出文件来查看结果。

2.pandas

pandas模块提供了一个loc函数,它可以同时选择特定的行与列。使用pandas模块的代码如下:

#!/usr/bin/env python3

import pandas as pd

import sys

input_file = sys.argv[1]

output_file = sys.argv[2]

data_frame = pd.read_csv(input_file)

data_frame['Cost'] = data_frame['Cost'].str.strip('$').astype(float)

data_frame_value_meets_condition = data_frame.loc[(data_frame['Supplier Name'].str.contains('Z'))

| (data_frame['Cost'] > 600.0), :]

data_frame_value_meets_condition.to_csv(output_file, index=False)

我们在命令行窗口运行这个脚本,同样地,在屏幕上我们看不到任何输出,我们可以打开输出文件查看结果。

此处省略输出结果。

行中的值属于某个集合

有些时候,当行中的值属于某个集合时,才需要保留这些行。例如,我们希望在数据集中保留那些供应商名字属于集合{Supplier X, Supplier Y}的行,或者希望保留所有购买日期属于集合{'1/20/2014', '1/30/2014'}的行。在这种情况下,我们可以检验行中的值是否属于某个集合,筛选出具有属于该集合的行。

1.基础Python

代码如下:

#!/usr/bin/env python3

import csv

import sys

input_file = sys.argv[1]

output_file = sys.argv[2]

important_dates = ['1/20/2014', '1/30/2014']

with open(input_file, 'r', newline='') as csv_in_file:

with open(output_file, 'w', newline='') as csv_out_file:

filereader = csv.reader(csv_in_file)

filewriter = csv.writer(csv_out_file)

header = next(filereader)

filewriter.writerow(header)

for row_list in filereader:

a_date = row_list[4]

if a_date in important_dates:

filewriter.writerow(row_list)

我们来讨论一下上述代码。

important_dates = ['1/20/2014', '1/30/2014']

这行代码创建了一个名为important_dates的列表变量,其中包含了两个特定日期。这个列表变量就是我们的集合。

a_date = row_list[4]

这行代码取出每一行的购买日期,并赋给变量a_date。

if a_date in important_dates:

filewriter.writerow(row_list)

这行代码创建了一个if语句来检验变量a_date中的购买日期是否属于集合important_date,如果变量值在集合中,下一行代码就将这一行写入输出文件。

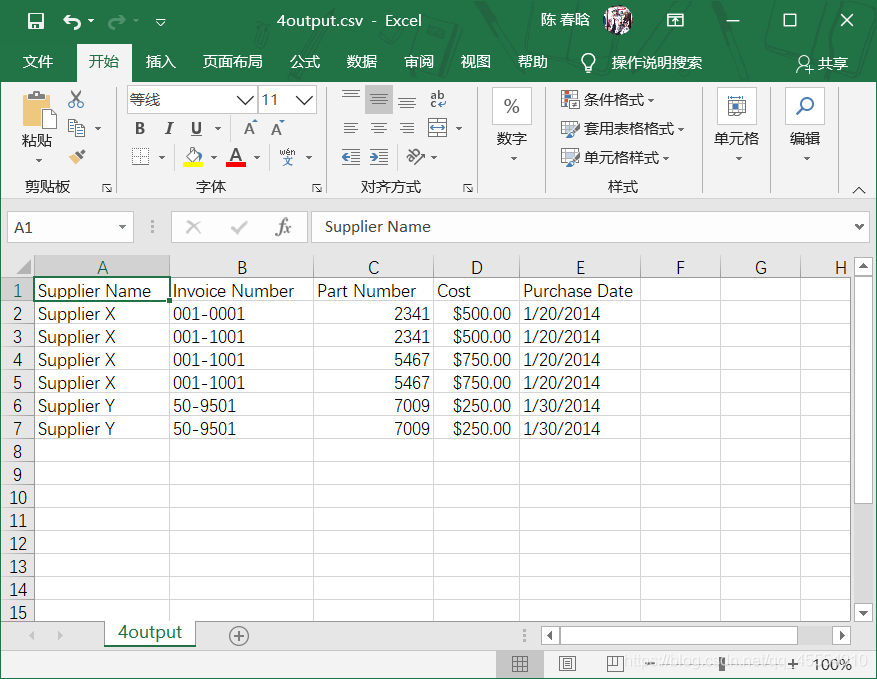

我们在命令行窗口中运行这个脚本,并打开输出文件来查看结果。

2.pandas

使用pandas模块的代码如下所示:

#!/usr/bin/env python3

import pandas as pd

import sys

input_file = sys.argv[1]

output_file = sys.argv[2]

data_frame = pd.read_csv(input_file)

important_dates = ['1/20/2014', '1/30/2014']

data_frame_value_in_set = data_frame.loc[data_frame['Purchase Date'].isin(important_dates), :]

data_frame_value_in_set.to_csv(output_file, index=False)

这里的输出结果和上面基础Python方法的输出结果一致,故省略。

行中的值匹配于某个模式(正则表达式)

有些时候,当行中的值匹配或包含一个特定模式(正则表达式)时,才需要保留这些行。例如,我们希望在数据集中保留所有发票开始于“001-”的行,或者希望保留所有供应商名字中包含“Y”的行。在这种情况下,我们可以检验行中的值是否匹配或包含某种模式,然后筛选出匹配或包含该模式的行。

1.基础Python

代码如下:

#!/usr/bin/env python3

import csv

import re

import sys

input_file = sys.argv[1]

output_file = sys.argv[2]

pattern = re.compile(r'(?P<my_pattern_group>^001-.*)', re.I)

with open(input_file, 'r', newline='') as csv_in_file:

with open(output_file, 'w', newline='') as csv_out_file:

filereader = csv.reader(csv_in_file)

filewriter = csv.writer(csv_out_file)

header = next(filereader)

filewriter.writerow(header)

for row_list in filereader:

invoice_number = row_list[1]

if pattern.search(invoice_number):

filewriter.writerow(row_list)

我们来讨论一下上述代码。

import re

这一行代码导入了re模块,也就是正则表达式模块。

pattern = re.compile(r'(?P<my_pattern_group>^001-.*)', re.I)

这行代码使用re模块的compile()函数创建变量pattern。其中r表示将单引号之间的模式当作原始字符串来处理。元字符?P<my_pattern_group>捕获了名为<my_pattern_group>的组中匹配了的字符串,以便在需要的时候将它们打印到屏幕或写入文件。这里要搜索的实际模式是^001-.*。插入符号^表示只在字符串开头搜索模式,*表示重复前面的字符0次或更多次,.*组合在一起使用表示除换行符\n之外的任意字符可以在“001-”后面出现任意次。最后,参数re.I告诉了正则表达式进行大小写敏感的匹配。

有关正则表达式的内容,可以参考我之前写的博客:Python与正则表达式。

if pattern.search(invoice_number):

filewriter.writerow(row_list)

这里使用re模块的search()函数在invoice_number的值中寻找模式,如果模式出现在变量值中,就将这行写入输出文件。

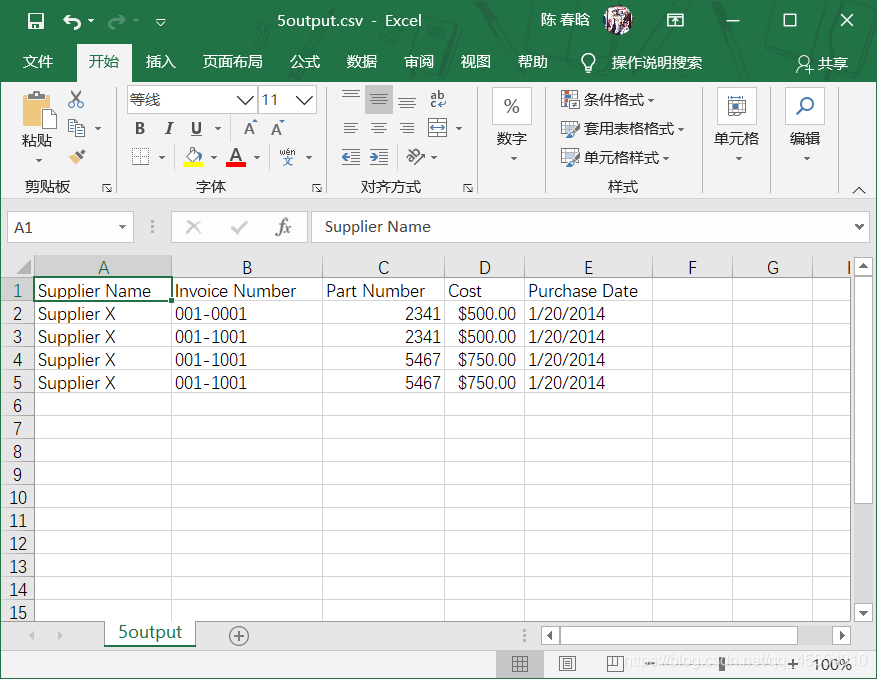

我们在命令行窗口运行这个脚本,得到输出文件如下图所示。

2.pandas

使用pandas模块的代码如下所示:

#!/usr/bin/env python3

import pandas as pd

import sys

input_file = sys.argv[1]

output_file = sys.argv[2]

data_frame = pd.read_csv(input_file)

data_frame_value_matches_pattern = data_frame.loc[data_frame['Invoice Number'].str.startswith("001-"), :]

data_frame_value_matches_pattern.to_csv(output_file, index=False)

上述代码中,startswith()函数用来搜索数据,不用再使用正则表达式。

这里的输出结果和上面基础Python方法的输出结果一致,故省略。

智能推荐

攻防世界_难度8_happy_puzzle_攻防世界困难模式攻略图文-程序员宅基地

文章浏览阅读645次。这个肯定是末尾的IDAT了,因为IDAT必须要满了才会开始一下个IDAT,这个明显就是末尾的IDAT了。,对应下面的create_head()代码。,对应下面的create_tail()代码。不要考虑爆破,我已经试了一下,太多情况了。题目来源:UNCTF。_攻防世界困难模式攻略图文

达梦数据库的导出(备份)、导入_达梦数据库导入导出-程序员宅基地

文章浏览阅读2.9k次,点赞3次,收藏10次。偶尔会用到,记录、分享。1. 数据库导出1.1 切换到dmdba用户su - dmdba1.2 进入达梦数据库安装路径的bin目录,执行导库操作 导出语句:./dexp cwy_init/[email protected]:5236 file=cwy_init.dmp log=cwy_init_exp.log 注释: cwy_init/init_123..._达梦数据库导入导出

js引入kindeditor富文本编辑器的使用_kindeditor.js-程序员宅基地

文章浏览阅读1.9k次。1. 在官网上下载KindEditor文件,可以删掉不需要要到的jsp,asp,asp.net和php文件夹。接着把文件夹放到项目文件目录下。2. 修改html文件,在页面引入js文件:<script type="text/javascript" src="./kindeditor/kindeditor-all.js"></script><script type="text/javascript" src="./kindeditor/lang/zh-CN.js"_kindeditor.js

STM32学习过程记录11——基于STM32G431CBU6硬件SPI+DMA的高效WS2812B控制方法-程序员宅基地

文章浏览阅读2.3k次,点赞6次,收藏14次。SPI的详情简介不必赘述。假设我们通过SPI发送0xAA,我们的数据线就会变为10101010,通过修改不同的内容,即可修改SPI中0和1的持续时间。比如0xF0即为前半周期为高电平,后半周期为低电平的状态。在SPI的通信模式中,CPHA配置会影响该实验,下图展示了不同采样位置的SPI时序图[1]。CPOL = 0,CPHA = 1:CLK空闲状态 = 低电平,数据在下降沿采样,并在上升沿移出CPOL = 0,CPHA = 0:CLK空闲状态 = 低电平,数据在上升沿采样,并在下降沿移出。_stm32g431cbu6

计算机网络-数据链路层_接收方收到链路层数据后,使用crc检验后,余数为0,说明链路层的传输时可靠传输-程序员宅基地

文章浏览阅读1.2k次,点赞2次,收藏8次。数据链路层习题自测问题1.数据链路(即逻辑链路)与链路(即物理链路)有何区别?“电路接通了”与”数据链路接通了”的区别何在?2.数据链路层中的链路控制包括哪些功能?试讨论数据链路层做成可靠的链路层有哪些优点和缺点。3.网络适配器的作用是什么?网络适配器工作在哪一层?4.数据链路层的三个基本问题(帧定界、透明传输和差错检测)为什么都必须加以解决?5.如果在数据链路层不进行帧定界,会发生什么问题?6.PPP协议的主要特点是什么?为什么PPP不使用帧的编号?PPP适用于什么情况?为什么PPP协议不_接收方收到链路层数据后,使用crc检验后,余数为0,说明链路层的传输时可靠传输

软件测试工程师移民加拿大_无证移民,未受过软件工程师的教育(第1部分)-程序员宅基地

文章浏览阅读587次。软件测试工程师移民加拿大 无证移民,未受过软件工程师的教育(第1部分) (Undocumented Immigrant With No Education to Software Engineer(Part 1))Before I start, I want you to please bear with me on the way I write, I have very little gen...

随便推点

Thinkpad X250 secure boot failed 启动失败问题解决_安装完系统提示secureboot failure-程序员宅基地

文章浏览阅读304次。Thinkpad X250笔记本电脑,装的是FreeBSD,进入BIOS修改虚拟化配置(其后可能是误设置了安全开机),保存退出后系统无法启动,显示:secure boot failed ,把自己惊出一身冷汗,因为这台笔记本刚好还没开始做备份.....根据错误提示,到bios里面去找相关配置,在Security里面找到了Secure Boot选项,发现果然被设置为Enabled,将其修改为Disabled ,再开机,终于正常启动了。_安装完系统提示secureboot failure

C++如何做字符串分割(5种方法)_c++ 字符串分割-程序员宅基地

文章浏览阅读10w+次,点赞93次,收藏352次。1、用strtok函数进行字符串分割原型: char *strtok(char *str, const char *delim);功能:分解字符串为一组字符串。参数说明:str为要分解的字符串,delim为分隔符字符串。返回值:从str开头开始的一个个被分割的串。当没有被分割的串时则返回NULL。其它:strtok函数线程不安全,可以使用strtok_r替代。示例://借助strtok实现split#include <string.h>#include <stdio.h&_c++ 字符串分割

2013第四届蓝桥杯 C/C++本科A组 真题答案解析_2013年第四届c a组蓝桥杯省赛真题解答-程序员宅基地

文章浏览阅读2.3k次。1 .高斯日记 大数学家高斯有个好习惯:无论如何都要记日记。他的日记有个与众不同的地方,他从不注明年月日,而是用一个整数代替,比如:4210后来人们知道,那个整数就是日期,它表示那一天是高斯出生后的第几天。这或许也是个好习惯,它时时刻刻提醒着主人:日子又过去一天,还有多少时光可以用于浪费呢?高斯出生于:1777年4月30日。在高斯发现的一个重要定理的日记_2013年第四届c a组蓝桥杯省赛真题解答

基于供需算法优化的核极限学习机(KELM)分类算法-程序员宅基地

文章浏览阅读851次,点赞17次,收藏22次。摘要:本文利用供需算法对核极限学习机(KELM)进行优化,并用于分类。

metasploitable2渗透测试_metasploitable2怎么进入-程序员宅基地

文章浏览阅读1.1k次。一、系统弱密码登录1、在kali上执行命令行telnet 192.168.26.1292、Login和password都输入msfadmin3、登录成功,进入系统4、测试如下:二、MySQL弱密码登录:1、在kali上执行mysql –h 192.168.26.129 –u root2、登录成功,进入MySQL系统3、测试效果:三、PostgreSQL弱密码登录1、在Kali上执行psql -h 192.168.26.129 –U post..._metasploitable2怎么进入

Python学习之路:从入门到精通的指南_python人工智能开发从入门到精通pdf-程序员宅基地

文章浏览阅读257次。本文将为初学者提供Python学习的详细指南,从Python的历史、基础语法和数据类型到面向对象编程、模块和库的使用。通过本文,您将能够掌握Python编程的核心概念,为今后的编程学习和实践打下坚实基础。_python人工智能开发从入门到精通pdf