(一)名称解释

fsimage,namenode的元数据镜像文件,保存在磁盘

editlog,namenode操作日志

fstime,最近一次的checkpoint时间

metadata,一个文件存储在哪些DataNode节点的哪些位置的元数据信息

NN,namenode

SNN,secondarynamenode

Namenode主要维护两个文件,一个是fsimage,一个是editlog

(二)

如何查看fsimage和editlog

查看hdfs-site.xml,查看

dfs.namenode.name.dir的配置值,我的配置为

/var/lib/hadoop-hdfs/cache/hdfs/dfs/name/current/

cd

/var/lib/hadoop-hdfs/cache/hdfs/dfs/name/current/

ll

输出为

-rw-r--r-- 1 hdfs hdfs 238K Aug 7 2017 edits_0000000000000069606-0000000000000071239

-rw-r--r-- 1 hdfs hdfs 239K Aug 7 2017 edits_0000000000000071240-0000000000000072884

-rw-r--r-- 1 hdfs hdfs 238K Aug 7 2017 edits_0000000000000072885-0000000000000074518

-rw-r--r-- 1 hdfs hdfs 289K Aug 7 2017 edits_0000000000000074519-0000000000000076555

-rw-r--r-- 1 hdfs hdfs 269K Aug 7 2017 edits_0000000000000076556-0000000000000078473

-rw-r--r-- 1 hdfs hdfs 237K Aug 7 2017 edits_0000000000000078474-0000000000000080104

-rw-r--r-- 1 hdfs hdfs 1.0M Aug 8 2017 edits_0000000000000080105-0000000000000081013

-rw-r--r-- 1 hdfs hdfs 11K Jun 3 22:34 edits_0000000000000081014-0000000000000081083

-rw-r--r-- 1 hdfs hdfs 242K Jun 3 23:34 edits_0000000000000081084-0000000000000082753

-rw-r--r-- 1 hdfs hdfs 1.0M Jun 3 23:34 edits_0000000000000082754-0000000000000082758

-rw-r--r-- 1 hdfs hdfs 1.0M Jun 4 00:02 edits_0000000000000082759-0000000000000083550

-rw-r--r-- 1 hdfs hdfs 127K Jun 4 00:35 edits_0000000000000083551-0000000000000084425

-rw-r--r-- 1 hdfs hdfs 250K Jun 4 07:52 edits_0000000000000084426-0000000000000086156

-rw-r--r-- 1 hdfs hdfs 238K Jun 4 08:52 edits_0000000000000086157-0000000000000087789

-rw-r--r-- 1 hdfs hdfs 239K Jun 4 09:52 edits_0000000000000087790-0000000000000089425

-rw-r--r-- 1 hdfs hdfs 238K Jun 4 10:52 edits_0000000000000089426-0000000000000091058

-rw-r--r-- 1 hdfs hdfs 1.0M Jun 4 11:15

edits_inprogress_0000000000000091059

-rw-r--r-- 1 hdfs hdfs 312K Jun 4 09:52 fsimage_0000000000000089425

-rw-r--r-- 1 hdfs hdfs 62 Jun 4 09:52 fsimage_0000000000000089425.md5

-rw-r--r-- 1 hdfs hdfs 317K Jun 4 10:52

fsimage_0000000000000091058

-rw-r--r-- 1 hdfs hdfs 62 Jun 4 10:52 fsimage_0000000000000091058.md5

-rw-r--r-- 1 hdfs hdfs 6 Jun 4 10:52 seen_txid

-rw-r--r-- 1 hdfs hadoop 202 Jun 3 22:33 VERSION

(三)什么是FSImage和EditsLog

fsimage保存了最新的元数据检查点,包含了整个HDFS文件系统的所有目录和文件的信息。

对于文件来说包括了数据块描述信息、修改时间、访问时间等;

对于目录来说包括修改时间、访问权限控制信息(目录所属用户,所在组)等。

上面数据中,通过

edits_inprogress_0000000000000091059

,可以看出fsimage文件已经加载到了最新的一个

edits_0000000000000089426-0000000000000

091058文件,仅仅只有inprogress状态的edit log未被加载。在启动HDFS时,只需要读入

fsimage_0000000000000091058以及

edits_inprogress_0000000000000091059就可以还原出当前hdfs的最新状况。但是这里又会出现一个问题,如果edit log文件越来越多、越来越大时,当重新启动hdfs时,由于需要加载fsimage后再把所有的edit log也加载进来,就会出现第一段中出现的问题了。怎么解决?HDFS会采用checkpoing机制定期将edit log合并到fsimage中生成新的fsimage。分析见(四)

(四)checkpoint机制

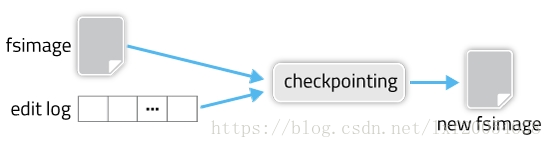

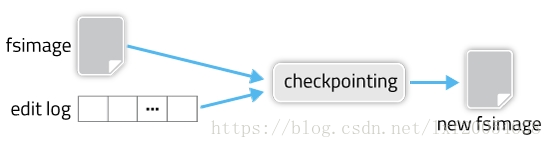

fsimage和edit log合并的过程如下图所示:

考虑到合并过程很耗费磁盘IO,网络IO,CPU,合并过程都放在secondarynamenode【SN】上进行。

checkpoint的触发条件:

--满足dfs.namenode.checkpoint.preiod【默认1小时】时间点

--或者满足dfs.namenode.checkpoint.txns【默认100万次txns id】

合并步骤

- SNN告诉NN滚动inprogress editlog文件,这样新的操作都会写到新的editlog文件,同事,NN更新seen_txid

- SNN通过http get方式从NN获取最新的fsimage和editlog

- SNN将fsimage加载到内存,并从editlog中读取每一次事务,应用到fsimage,这样就产生了一个新的fsimage

- SNN将新的fsimage通过http put的方式发送到NN,NN将fsimage保存为临时fsimage.ckpt文件中

- NN将fsimage.ckpt文件重命名,此完成了fsimage和editlog的同步

hadoop集群配置高可用时,checkpoint机制参考(四)

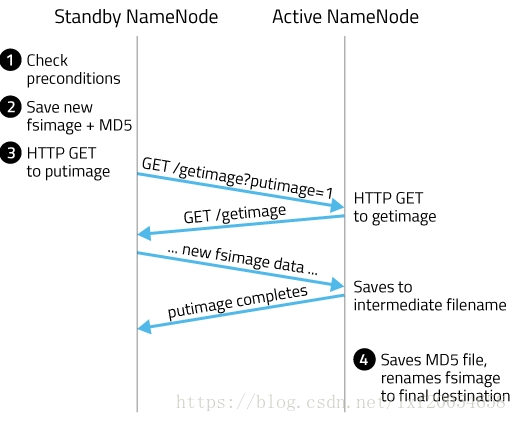

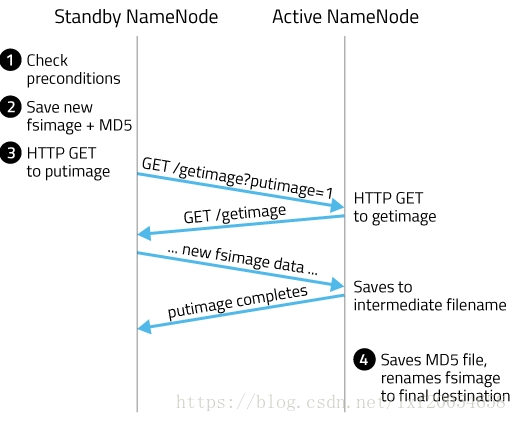

(四)HA模式下Checkpointing过程分析

在HA模式下,checkpoint过程由standBy namenode进行【SBNN】,active namenode【ACNN】

HA模式下的edit log文件会同时写入多个JournalNodes节点的dfs.journalnode.edits.dir路径下,JournalNodes的个数为大于1的奇数,类似于Zookeeper的节点数,当有不超过一半的JournalNodes出现故障时,仍然能保证集群的稳定运行。

同步过程如图:

思考:同步使用http,而不是RPC,为什么呢?

(五)查看fsimage文件

启动

hdfs oiv -i fsimage_0000000000000092691

屏幕输出

18/06/04 11:58:08 INFO offlineImageViewer.FSImageHandler: Loading 15 strings

18/06/04 11:58:08 INFO offlineImageViewer.FSImageHandler: Loading 4592 inodes.

18/06/04 11:58:08 INFO offlineImageViewer.FSImageHandler: Loading inode references

18/06/04 11:58:08 INFO offlineImageViewer.FSImageHandler: Loaded 0 inode references

18/06/04 11:58:08 INFO offlineImageViewer.FSImageHandler: Loading inode directory section

18/06/04 11:58:08 INFO offlineImageViewer.FSImageHandler: Loaded 1887 directories

18/06/04 11:58:08 INFO offlineImageViewer.WebImageViewer: WebImageViewer started. Listening on /127.0.0.1:5978. Press Ctrl+C to stop the viewer.

执行

hdfs dfs -ls -R webhdfs://127.0.0.1:5978/

输出内容:

drwx------ - cloudera cloudera 0 2017-08-07 19:08 webhdfs://127.0.0.1:5978/user/cloudera/.Trash

drwx------ - cloudera cloudera 0 2017-08-05 23:39 webhdfs://127.0.0.1:5978/user/cloudera/.Trash/170807190802

drwx------ - cloudera cloudera 0 2017-08-05 23:39 webhdfs://127.0.0.1:5978/user/cloudera/.Trash/170807190802/user

drwx------ - cloudera cloudera 0 2017-08-05 23:39 webhdfs://127.0.0.1:5978/user/cloudera/.Trash/170807190802/user/hive

drwx------ - cloudera cloudera 0 2017-08-06 23:38 webhdfs://127.0.0.1:5978/user/cloudera/.Trash/170807190802/user/hive/warehouse

drwx------ - cloudera cloudera 0 2017-08-07 17:19 webhdfs://127.0.0.1:5978/user/cloudera/.Trash/170807190802/user/hive/warehouse/ibeifeng.db

drwxrwxrwx - cloudera supergroup 0 2017-08-07 00:45 webhdfs://127.0.0.1:5978/user/cloudera/.Trash/170807190802/user/hive/warehouse/ibeifeng.db/session_info

-rwxrwxrwx 1 cloudera supergroup 5498008 2017-08-07 00:45 webhdfs://127.0.0.1:5978/user/cloudera/.Trash/170807190802/user/hive/warehouse/ibeifeng.db/session_info/000000_0

drwxrwxrwx - cloudera supergroup 0 2017-08-07 17:09 webhdfs://127.0.0.1:5978/user/cloudera/.Trash/170807190802/user/hive/warehouse/ibeifeng.db/session_info1502096965787

drwxrwxrwx - cloudera supergroup 0 2017-08-07 17:09 webhdfs://127.0.0.1:5978/user/cloudera/.Trash/170807190802/user/hive/warehouse/ibeifeng.db/session_info1502097580348

导出fsimage到xml文件命令

hdfs oiv -p XML -i fsimage_0000000000000092691 -o fsimage.xml

(六)导出editlog文件到xml

hdfs oev -i edits_0000000000000091059-0000000000000092691 -o edit.xml

部分文件内容

<?xml version="1.0" encoding="UTF-8"?>

<EDITS>

<EDITS_VERSION>-60</EDITS_VERSION>

<RECORD>

<OPCODE>OP_START_LOG_SEGMENT</OPCODE>

<DATA>

<TXID>91059</TXID>

</DATA>

</RECORD>

<RECORD>

<OPCODE>OP_ADD</OPCODE>

<DATA>

<TXID>91060</TXID>

<LENGTH>0</LENGTH>

<INODEID>42793</INODEID>

<PATH>/user/spark/applicationHistory/.1b3d5ff3-4187-42b7-9d06-0b4224e1b988</PATH>

<REPLICATION>1</REPLICATION>

<MTIME>1528080778475</MTIME>

<ATIME>1528080778475</ATIME>

<BLOCKSIZE>134217728</BLOCKSIZE>

<CLIENT_NAME>DFSClient_NONMAPREDUCE_-2124177401_1</CLIENT_NAME>

<CLIENT_MACHINE>127.0.0.1</CLIENT_MACHINE>

<OVERWRITE>true</OVERWRITE>

<PERMISSION_STATUS>

<USERNAME>spark</USERNAME>

<GROUPNAME>supergroup</GROUPNAME>

<MODE>420</MODE>

</PERMISSION_STATUS>

<RPC_CLIENTID>3143bf48-a33d-4800-ad82-3579e2c40b43</RPC_CLIENTID>

<RPC_CALLID>8108</RPC_CALLID>

</DATA>

</RECORD>

<RECORD>

<OPCODE>OP_CLOSE</OPCODE>

<DATA>

<TXID>91061</TXID>

<LENGTH>0</LENGTH>

<INODEID>0</INODEID>

<PATH>/user/spark/applicationHistory/.1b3d5ff3-4187-42b7-9d06-0b4224e1b988</PATH>

<REPLICATION>1</REPLICATION>

<MTIME>1528080778479</MTIME>

<ATIME>1528080778475</ATIME>

<BLOCKSIZE>134217728</BLOCKSIZE>

<CLIENT_NAME></CLIENT_NAME>

<CLIENT_MACHINE></CLIENT_MACHINE>

<OVERWRITE>false</OVERWRITE>

<PERMISSION_STATUS>

<USERNAME>spark</USERNAME>

<GROUPNAME>supergroup</GROUPNAME>

<MODE>420</MODE>

</PERMISSION_STATUS>

</DATA>

</RECORD>

<RECORD>

<OPCODE>OP_RENAME_OLD</OPCODE>

<DATA>

<TXID>92690</TXID>

<LENGTH>0</LENGTH>

<SRC>/user/hue/.cloudera_manager_hive_metastore_canary/hive_HIVEMETASTORE</SRC>

<DST>/user/hue/.Trash/Current/user/hue/.cloudera_manager_hive_metastore_canary/hive_HIVEMETASTORE1528084369048</DST>

<TIMESTAMP>1528084369049</TIMESTAMP>

<RPC_CLIENTID>683845ea-3b6b-4419-9d9d-144a85344b40</RPC_CLIENTID>

<RPC_CALLID>4691</RPC_CALLID>

</DATA>

</RECORD>

<RECORD>

<OPCODE>OP_END_LOG_SEGMENT</OPCODE>

<DATA>

<TXID>92691</TXID>

</DATA>

</RECORD>

</EDITS>

在输出的xml文件中,每个RECORD记录了一次操作,比如图中的OP_ADD代表添加文件操作,OP_MKDIR代表创建目录操作。里面还记录了文件路径(PATH),修改时间(MTIME)、添加时间(ATIME)、客户端名称(CLIENT_NAME)、客户端地址(CLIENT_MACHINE)、权限(PERMISSION_STATUS)等非常有用的信息。