”conv3d“ 的搜索结果

使用UCF101完成的视频动作分类识别,使用Conv3D模型完成,不过因为模型参数pth太大了,CSDN放不下,需要私聊吧

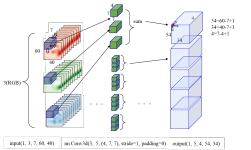

在本例中,输入的大小是(1,3,7,h,w)、kernel的大小是(3,7,7)的时候,就是同时对3帧进行处理,所以计算方法就是7-3+1=5,所以输出的大小是(1,3,5,h‘,w‘),从这个计算过程可以看出在默认情况下也就是在时间上的...

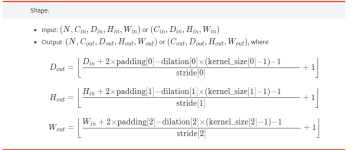

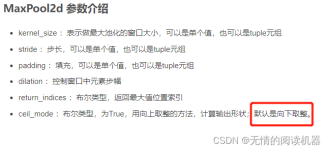

空洞卷积,膨胀卷积在Pytorch中,dilation = 1等同于没有dilation的标准卷积。当dilation为1时,卷积核中的每个元素都紧挨着;而当dilation为2时,卷积核中的每个元素之间都会间隔一个元素。通过调整dilation的大小...

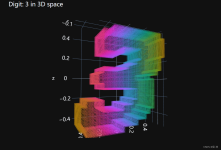

CNN是深度学习的重中之重,而conv1D,conv2D,和conv3D又是CNN的核心,所以理解conv的工作原理就变得尤为重要。

c3d的预训练模型

【代码】详解Keras3.0 Layers API: Convolution layers(Conv1D、Conv2D、Conv3D)

无论是conv3d还是conv2d,不同的通道都表示不同的特征,都是独立于卷积核的构建的,也不会是卷积的方向;卷积都是分别在不同通道上进行的,最后将所有通道的卷积结果相加.通道数即为卷积核的个数.

本文将介绍pytorch高维张量的乘法、卷积操作(conv2d、conv3d)

Dilated/Atrous Convolution(中文叫做空洞卷积或者膨胀卷积) 或者是 Convolution with holes 从字面上就很好理解,是在标准的 convolution map 里注入空洞,以此来增加 reception field。

在项目中用到了conv3但是对其背后的原理还有一些模糊的地方,conv2d与多通道的...conv3d的思想理论是什么?对此进行探究和记录...... 首先要明确多通道的2d卷积和3d卷积是不一样的,3d是可以在通道中移动的,2d不可以

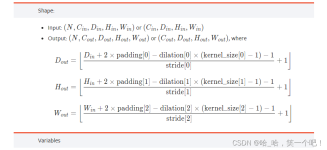

前言需要用到3DCNN,于是找到了torch.nn.conv3d,网上太多人写参数解读,但没什么人能讲得清楚的,于是我边理解边写代码验证,得到了我想要的结果。实例用3DCNN的开篇之作来当作例子解读一下这个函数的参数,首先来...

卷积(convolution),是一种运算,你可以类比于加,减,乘,除,矩阵的点乘与叉乘等等,它有自己的运算规则,卷积的符号是星号。表达式为:连续卷积表达式:离散卷积表达式为:从参数上来看,x + (n-x) = n,可以...

keras.layers.Conv3D

本文介绍了pytorch中如何使用conv3d计算3d卷积,介绍了各个参数、输入输出各个通道的意义,并给出了示例代码供大家参考

问题描述: 请问,我想对后三纬度进行指定填充,该怎么做呢? 上面代码会报错解答:padding的数据类型是一个整数或六个整数的元组。

推荐文章

- 【Python】pydub按一定比特率、采样率压缩音频文件_python mp3文件压缩-程序员宅基地

- 【析构函数】_eotteon-程序员宅基地

- VMware虚拟机下安装CentOS系统超详细教程_archive.kernel.orglcentos-程序员宅基地

- STM32毕设题目选题大全-程序员宅基地

- abaqus复合材料建模技术与应用-程序员宅基地

- java计算机毕业设计高校社区生鲜配送系统MyBatis+系统+LW文档+源码+调试部署-程序员宅基地

- Git下载安装教程-程序员宅基地

- PCL教程指南-估计点云法向量_求点云法向量sota-程序员宅基地

- 云服务器centos8搭建网站 apache+php+mysql_centos8搭建博客网站-程序员宅基地

- LeetCode 每日一题 Day 33&34(hard)&35 ||二进制枚举/单调栈/链表遍历-程序员宅基地