”jieba“ 的搜索结果

jieba停用词分词表

标签: jieba

jieba停用词分词表

本文将手把手教会你使用jieba库进行中文分词和去除停用词,这是学会文本分析的必经之路!

jieba库是一款开源的中文分词工具,能够将中文文本切分成词语。使用和可在程序中动态修改词典。如果有一个包含自定义词语的文件,可以使用方法加载该文件,并将其中的词语加入到词典中。本教程介绍了Python中jieba库...

本篇文章介绍jieba库的安装和应用

python-jieba文件包,解压后将两个文件夹放入 工程文件--->venv(或自定义的配置文件夹)--->Lib--->site-packages中使用

Python的jieba库是一个中文分词工具,它可以将一段中文文本分割成一个一个的词语,方便后续的自然语言处理任务,如文本分类、情感分析等。jieba库使用了基于前缀词典的分词方法,能够处理中文的各种复杂情况,如歧义...

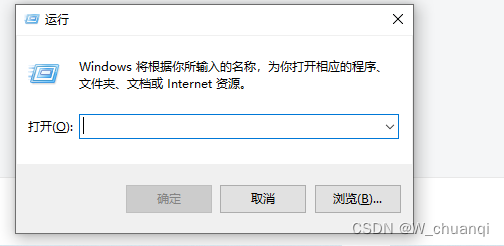

jieba介绍以及分词的原理 1. jieba 是Python中的优秀的中文分词第三方库 --中文文本需要通过分词获得单个的词语 2. jieba 库提供三种分词模式 ,最简单只需要掌握一个函数 3.jieba库的安装 只需要在cmd 中,...

在Rust jieba-rs中实现的jieba中文分词在Rust安装中实现jieba中文分词将其添加到Cargo.toml:[dependencies] jieba-rs =“ 0.6”那么您就很好了。 如果您使用的是Rust 2015,则还必须将板条jieba_rs外部化为板条根。...

分词es插件,elasticsearch-jieba-plugin 8.8.2已编译,解压到 elasticsearch-8.8.2\plugins\ 重启es

情感分析,结巴分词,词云展示的一个小例子,见效

结巴jieba分词的c#版本,可实现多种分词形式,支持自定义用户词典

“结巴”中文分词:做最好PHP中文分词,中文断词组件,当前翻译版本为jieba-0.33版本,未来再慢慢往上升级,效能也需要再改善,请有兴趣的开发者一起加入开发!若想使用Python版本请前往现在已经可以支持繁体中文!...

import jieba def replaceSynonymWords(string1): # 1读取同义词表,并生成一个字典。 combine_dict = {} # synonymWords.txt是同义词表,每行是一系列同义词,用空格分割 for line in open(TihuanWords.txt, r,...

语句中关键字在含有英文和特殊字符时(machine-1234),使用jieba往往将我们的关键词分割的非常零碎,比如: # 默认情况 import jieba str1 = 查找machine-1234的产品说明书 for w in jieba.cut(str1): print(w) # ...

jieba-0.42版集合包.rar,本人亲试,保证能用。

jieba分词的自定义词典:使用jieba分词对语料进行分词之前,需要先载入,载入代码为jieba.load_userdict("userdict.txt")。

资源分类:Python库 所属语言:Python 资源全名:jieba_fast-0.51.tar.gz 资源来源:官方 安装方法:https://lanzao.blog.csdn.net/article/details/101784059

问题出在我的电脑上【狗头.jpg】,它卡了一下,我就无意点了哪,它所有程序报错,我就重启pycharm,然后我别的程序没问题了,有关jieba的程序仍旧报错???? 我盯着程序看了会儿,没找出问题;我接着去百度,似乎...

使用jieba库对论文进行相似度的比较以对其进行分类。 源码为001.py,003.py,004.py三个文件,其中001.py负责将原文转为utf-8格式,用户直接运行即可,003.py可以将训练集中的论文进行分词——这一步就要用到jieba库...

Java-Jieba Jieba 0.39 的 Java 复刻版,支持原版 Jieba 的所有核心功能 写在前面 这是我为了入门 Java 而尝试构建的第一个工程,目的是为了熟悉 Java 的一些基本语法和常用类库,并学习一些简单的 Java 类设计。之...

elasticsearch-jieba-plugin 是 Jieba 中文分词插件。试用 Elasticsearch 5.1.2 版本,基于 huaban 开源的的 jieba java 实现。使用checkout tag: v5.1.2git checkout v5.1.2运行gradle buildPluginZip创建 ...

“结巴”中文分词:做最好的 Python 中文分词组件

jieba-0.42.1.tar.gz

jieba 基于Python的中文分词工具,安装使用非常方便,直接pip即可,2/3都可以,功能强悍,十分推荐。 中文分词(Chinese Word Segmentation) 指的是将一个汉字序列切分成一个一个单独的词。 分词模块jieba,它是...

import jieba font = r'C:\Windows\Fonts\simfang.ttf' w = wordcloud.WordCloud(height = 700, width = 1000, font_path=font, \ stopwords=['et','al', 'Crampin', 'and','the', 'Liu'], max_words=30) with open...

中文分词工具jieba 。相比其他分词工具而言,jieba不仅只有分词这一功能,它还提供了许多分词以外的算法,支持Python、R、C++等多种编程语言的实现,使用简单,对于新手而言是一个较好的入门分词工具

jieba分词所需要使用的jar包 结巴分词的使用比较方便,效果也不错,也无需连接网络即可使用。在项目中使用到了结巴分词,故在此保存备份。

jieba库的基本使用

标签: ie jieba

import jieba # 朱自清散文节选 text = '人生就是一种承受,一种压力,让我们在负重中前行,在逼迫中奋进。无论走到哪里,我们都要学会支撑自己,没有人陪你走一辈子,所以你要适应孤独,没有人会帮你一辈子,所以你...

推荐文章

- Windows系统鼠标右键菜单添加打开cmd终端_we右键进入cmd-程序员宅基地

- python汇编语言还是机器语言_深入理解计算机系统(3.1)------汇编语言和机器语言...-程序员宅基地

- android毕设各种app项目,安卓毕设,android毕设_app毕业设计-程序员宅基地

- Keil侧边工具栏(项目窗口)打开方式_keil侧边栏-程序员宅基地

- 算法学习,转载记录(持续记录)-程序员宅基地

- 局域网探测器_局域网检测-程序员宅基地

- 【C语言基础系列,阿里java面试流程_c语言java面试-程序员宅基地

- Linux技术简历项目经验示例(二)_linux简历工作经验怎么写-程序员宅基地

- 安卓手机软键盘弹出后不响应onKeyDown、onBackPressed方法解决方案-程序员宅基地

- 使用二维数组实现存储学生成绩_c#创建控制台应用程序studentscore,生成学生成绩单——二维数组的使用。-程序员宅基地