”神经网络优化器“ 的搜索结果

要构造一个优化器,你必须给它一个包含要优化的参数(都应该是变量)的迭代。loss.backward() #反向传播,得到每一个要更新的参数的梯度。要使用 torch.optim,必须构造一个优化器对象,该对象将保持当前状态并根据...

基于Pytorch全连接神经网络优化器Adam实现天气温度的回归预测项目源码.zip 该项目是个人大作业项目源码,评审分达到95分以上,都经过严格调试,确保可以运行!放心下载使用。 基于Pytorch全连接神经网络优化器Adam...

每次随机取一个样本。BGD每次迭代都会朝着最优解逼近,而SGD由于噪音比BGD多,多以SGD并不是每次迭代都朝着最优解逼近,但大体方向是朝着最优解,SGD大约要遍历1-10次数据次来获取最优解。Adagrad会累加之前所有的...

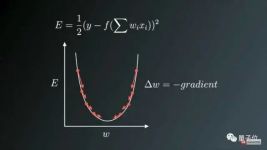

在深度学习中,优化器(optimizer)是一种用于调整神经网络模型参数以最小化损失函数的算法。优化器的目标是根据输入数据和期望的输出标签来调整模型的权重和偏置,使得模型能够更好地拟合训练数据并在未见过的数据...

MATLAB 中常用的神经网络优化算法包括以下几种: 背景误差反向传播(Backpropagation):通过计算网络输出和实际目标之间的误差,然后反向传播更新网络参数。这是最基本的神经网络优化算法,在 MATLAB 中可以使用...

这样可以使得梯度较大的参数的学习率较小,梯度较小的参数的学习率较大,从而更好地优化模型。在每次迭代中,Adam算法计算每个参数的梯度和历史梯度信息,并使用这些信息来更新每个参数的值。动量项可以帮助算法跳出...

几种深度学习中常用的优化器对比

优化器是深度学习中用于优化神经网络模型的一类算法,其主要作用是根据模型的损失函数来调整模型的参数,使得模型能够更好地拟合训练数据,提高模型的性能和泛化能力。优化器在训练过程中通过不断更新模型的参数,使...

从这篇文章开始,分析神经网络的优化器以及其在keras框架中的实现。在前面讲过,神经网络的编写分成:准备数据、搭建网络结构、配置算法参数这几步,其中配置算法参数是关键的一步,而optimizer的配置是其中的重中之...

优化器作用:求出让损失函数最小化的参数 1、Adam 关联所有样本的梯度,便于求解全局最优解,始终含有前面梯度的信息,把前面的梯度传到后面 优点:自动调节学习率, 速度快, 梯度传导 optimizer=tf.train.Adam...

1. SGD 1.1 batch-GD 每次更新使用全部的样本,注意会对所有的样本取均值,这样每次更新的速度慢。计算量大。 1.2 SGD 每次随机取一个样本。这样更新速度更快。SGD算法在于每次只去拟合一个训练样本,这使得在梯度...

利用BP神经网络优化PID控制器参数,实现在线整定,达到最优化。

MATLAB神经网络和优化算法:29 SVM神经网络中参数优化提升分类器性能.zip

在本文中,我将讨论与神经网络优化有关的以下概念: 优化面临的挑战 动量 适应性学习率 参数初始化 批量归一化 优化面临的挑战 当谈论神经网络中的优化时,我们其实是在讨论非凸优化问题(non-convex optimization)...

常见优化器介绍 Batch Gradient Descent(BGD) ★ 梯度更新规则: BGD 采用整个训练集的数据来计算 cost function 对参数的梯度。 ★ 缺点: 由于这种方法是在一次更新中,就对整个数据集计算梯度,所以计算...

Matlab神经网络43个案例分析。 BP神经网络的数据 BP神经网络的非线 遗传算法优化BP神 神经网络遗传算法函 基于BP_Adaboost的 PID神经元网络解耦 RBF网络的回归--非 GRNN网络的预测--- 离散Hopfield神经网 离散...

粒子群优化神经网络算法

标签: 算法

这是一种非常好的优化算法,可以完整运行,请放心下载。

一句话,用来更新和计算影响模型训练和模型输出的网络参数,使其逼近或达到最优值,从而最小化(或最大化)损失函数E(x)

matlab GA优化BP 遗传算法优化神经网络 matlab GA优化BP 遗传算法优化神经网络 matlab GA优化BP 遗传算法优化神经网络 matlab GA优化BP 遗传算法优化神经网络 matlab GA优化BP 遗传算法优化神经网络 matlab GA优化BP...

训练神经网络的时候不是应该用BP算法吗,为什么tensorflow中用梯度下降算法的优化器 就能实现对于神经网络权值的更新?

遗传算法优化神经网络matlab源码。此程序实现了利用遗传算法优化BP神经网络,内含matlab源码及遗传算法gaot工具包。亲测可用 神经网路 遗传算法 matlab。

群体智能优化算法是一类基于概率的随机搜索进化算法,各个算法之间存在结构、研究内容、计算方法等具有较大的相似性写作猫。因此,群体智能优化算法可以建立一个基本的理论框架模式:Step1:设置参数,初始化种群;...

Matlab用RBF神经网络优化PID控制器-用RBF神经网络优化PID控制器.rar 用RBF神经网络优化PID控制器

推荐文章

- 手写一个SpringMVC框架(有助于理解springMVC) 侵立删_springmvc可以用来写安卓后端吗-程序员宅基地

- 线性判别分析LDA((公式推导+举例应用))_lda推导-程序员宅基地

- C# 结构体(Struct)精讲_c# struct-程序员宅基地

- 支付宝Wap支付你了解多少?_阿里wap支付-程序员宅基地

- Java计算器编写,实现循环输入_java简易计算器可使用户多次输入-程序员宅基地

- 【多维Dij+DP】牛客小白月赛75 D-程序员宅基地

- Android之内存优化与OOM-程序员宅基地

- Azure Machine Learning - 视频AI技术_azure ai 視頻索引器-程序员宅基地

- 个人知识管理软件使用感受-程序员宅基地

- WWDC2019 ------深入理解App启动_wwdc app启动-程序员宅基地